|

Календарь мероприятий

июнь  2026 2026

Пн |

Вт |

Ср |

Чт |

Пт |

Сб |

Вс |

1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 | 17 | 18 | 19 | 20 | 21 | 22 | 23 | 24 | 25 | 26 | 27 | 28 | 29 | 30 | | | | | |

показать все

Новости партнеров

«Группа Астра» объявляет о выпуске гибридных цифровых прав

Читать далее

Утечки данных в РФ в 2025 году: почта и интернет остаются ключевыми каналами риска, а барьерами для эффективной защиты – нехватка кадров и дефицит бюджетов

Читать далее

Группа «Борлас» (включая компанию BeringPro) вошла в топ лидеров цифровой трансформации промышленности России

Читать далее

Хакеры могут «угонять» GitHub одним кликом

Читать далее

В столичном Аппарате бизнес-омбудсмена обсудили будущее регулирования VPN

Читать далее

показать все

Статьи

Эра немилосердия

Читать далее

Строительная отрасль России в одном цифровом пространстве: обзор сервиса «Всем подряд»

Читать далее

Суверенные облака: стратегия на 2026–2028

Читать далее

Российское ПО дорожает: как обосновать бюджет?

Читать далее

Управление данными: искусство превращения хаоса в актив

Читать далее

Точность до метра и сантиметра: как применяют технологии позиционирования

Читать далее

Как искусственный интеллект изменит экономику

Читать далее

Эпоха российской ориентации на Запад в сфере программного обеспечения завершилась

Читать далее

Сладкая жизнь

Читать далее

12 бизнес-концепций, которыми должны овладеть ИТ-руководители

Читать далее

показать все

|

А вдруг он будет за нас?

Главная /

Архив номеров / 2017 / Выпуск №06 (69) / А вдруг он будет за нас?

Рубрика:

Тема номера /

Искусственный интеллект

Facebook

Мой мир

Вконтакте

Одноклассники

Google+

Алексей Лагутенков, MBA Kingston University UK, ITSM Manager, MCSE+I, MCSE:S:M, MCDBA, MCDST

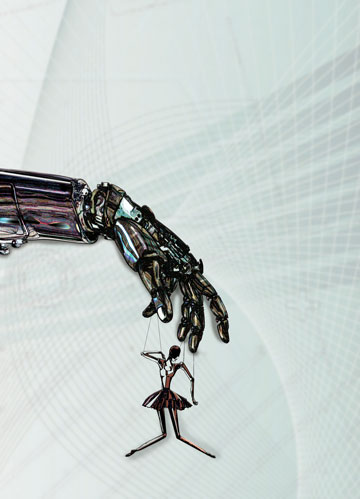

А вдруг он будет за нас?

Искусственный интеллект все ближе. Он уже готов вступить с нами в контакт и вмешаться в нашу жизнь, изменив ее навсегда. Хорошо это или плохо? И почему нам вообще следует об этом думать? Искусственный интеллект все ближе. Он уже готов вступить с нами в контакт и вмешаться в нашу жизнь, изменив ее навсегда. Хорошо это или плохо? И почему нам вообще следует об этом думать?

Недавно Илон Маск, выступая на встрече Национальной ассоциации губернаторов [1], сделал заявление, что «искусственный интеллект является основной угрозой, с которой человечество сталкивается как цивилизация». Интереснее всего в этом заявлении то, что оно в настоящем времени, не будущем. То есть человечество уже сталкивается.

В последнее время мы стали свидетелями множества странных заявлений. Например, Евросоюз даже пытался продвинуть законопроект о правах и обязанностях роботов и искусственного интеллекта. Тем не менее глупо было бы сравнивать заявление кучки фриков и интеллектуального гиганта, настоящего «железного человека» – Илона Маска. Нет никаких сомнений в том, что он говорит дело. Однако одни ли только фейковые новости угрожают цивилизации? Для того чтобы разобраться в том, о чем именно он говорит, нам придется чуть-чуть пофилософствовать.

Следует признать, что человечество как форма жизни мало что знает об его окружающем мире. Все, чем мы располагаем, – это база знаний, в которую собраны наблюдения многих поколений наших предков за тем местом, где мы живем, и за окружающими нас живыми существами и неживыми предметами, а также явлениями природы.

Наша физика, вернее наши две физики (для макрообъектов и совершенно иная для элементарных частиц) никак не соотносятся друг с другом. Так называемые законы физики из ньютоновской области никак не объясняют поведение элементарных и субэлементарных частиц. Наша незыблемая трех- или четырехмерная (если учитывать однонаправленное изменение времени) реальность и та под сомнением. Одиннадцатимерная модель, как ни крути, все же лучше объясняет многие явления нашего мира.

Наконец, мы не знаем никакой другой политики выживания, кроме логики биологического доминирования. Суть этого поведения в том, что некий биообъект должен обеспечивать превосходство над другими такими существами, то есть необходимо расширять территорию для жизни своего вида, добывать большее количество пищи и постоянно расширять возможности для размножения. Соответственно, все, что мы можем представить об окружающем нас мире, находится строго в рамках наших наблюдений за тем местом, где мы имеем удовольствие пребывать между рождением и смертью, а также в рамках логики биологического доминирования.

Теперь, давайте представим, что в нашем же мире существует параллельно другая цивилизация. Пусть это будут, например, камни, минералы. Просто представим, что они тоже разумны, но по-своему. Какой могла бы быть логика камней? Важны ли и понятны ли будут им наши ценности?

Минералам не нужно доминирование в том виде, в каком к нему привыкли мы. Им не нужно пространство, поскольку они сами и формируют все то пространство, в котором мы находимся. Им не нужна пища в понятном для нас смысле этого слова. Им не нужно размножаться, по крайней мере в таком виде, как к тому привыкли мы. Развитие и формирование минералов происходят глубоко в земной коре, где никто из людей не был лично, и, соответственно, никто не представляет, что там конкретно происходит (теоретические модели не в счет). Процессы в коре протекают многие миллионы и даже сотни миллионов лет, а на поверхность, к нам, по сути, попадают глубокие старики, а возможно, даже покойники.

Сопоставить время формирования минерала с жизнью человека или даже всего человечества невозможно. Все люди – всего лишь мгновенная вспышка в почти бесконечной жизни какого-нибудь алмаза. Даже понятия смерти у нас совсем разные. Человек или зверушка, разделенные на несколько частей, немедленно погибают, поскольку части не наследуют свойство целого живого организма. Камней эти подробности не касаются, поскольку любая мельчайшая песчинка несет в себе сущность минерала, независимо от того, насколько изначально был велик размер этого камня. То есть даже если у камней есть сознание, мы никогда не сможем с ними «дружить» или хотя бы вступить в контакт для достижения каких-либо взаимовыгодных интересов. У нас нет и не может быть никаких общих точек соприкосновения, несмотря на то что мы находимся в ежедневном контакте.

Перейдем от минералов к ИТ и угрозам ИИ. Несмотря на абсолютно несовместимые отличия биологической и небиологической форм жизни, людям нравится приписывать непонятным явлениям вполне простые человеческие чувства, эмоции и логику поведения.

Каким образом в наших фантастических фильмах представляют нашествие роботов и искусственного интеллекта? Судя по классике вроде «Терминатора», «Матрицы» или «Трансформеров», создания рук человеческих должны обладать вполне человеческими амбициями – желанием доминировать в регионе (то есть им нужна большая территория и некие ресурсы). Вот с размножением роботов обычно выходит заминка. Тут у них все не так однозначно.

Собственно, этот третий пункт и ставит под сомнение всю схему: зачем доминировать, занимать большую территорию и потреблять большие ресурсы, если размножение у данных объектов не является приоритетной целью, как у людей? Логика людей зажата рамками срока жизни, то есть чем больше потомков мы оставим, тем выше вероятность сохранения людей как вида. Роботы же и ИИ в виде сетевой технологии теоретически бессмертны. Зачем бы им бесконечно размножаться, расходуя на это бессмысленное занятие ограниченные ресурсы той территории, где они пребывают?

| Роботы и ИИ в виде сетевой технологии теоретически бессмертны. Зачем бы им бесконечно размножаться, расходуя на это бессмысленное занятие ограниченные ресурсы той территории, где они пребывают? |

Однако вернемся от философии и кинематографа в реальный мир. В нашу жизнь уже вошел ИИ, и мы бы хотели понять, как именно он собирается нам угрожать. Для простоты будем предполагать, что под ИИ в этой статье понимается исключительно самообучающаяся нейронная сеть или комплекс таких сетей.

Рассмотрим два самых значительных недавних научных открытия в области изучения интеллектов: человеческого и не очень.

Во-первых, человеческий мозг, с которого создавался прототип нейронной сети, похоже, функционирует далеко за рамками трех измерений. Это означает, что, если мы будем наблюдать за работой человеческого мозга в трех измерениях, мы никогда не поймем, что там происходит. То, что нам кажется дырами, пустым трехмерным пространством, разделяющим всевозможные нейроны, дендриты и аксоны, в многомерной модели может оказаться чем-то очень значимым.

Ученые определили максимальную размерность пространства функционирования нашего мозг, равную одиннадцати [2]. Это означает, что для изучения мозга могут быть использованы только теоретические математические модели, но никак не объекты нашего физического мира. То есть, вероятнее всего, в ближайшее время человечеству предстоит разработать и запустить в эксплуатацию усовершенствованные искусственные n-мерные нейронные сети, где 11 ≥ n > 3.

Во-вторых, ученые заявили, что совершенно не представляют, как конкретно функционируют нейросети, уже находящиеся в эксплуатации. Постоянно усложняясь, технологии таких сетей стали своего рода черными ящиками. Можно запрограммировать логику их обучения, можно скормить им данные, необходимые для обучения, но понять и разобраться в тех структурах, которые создаст ИИ внутри себя и на основании которых он будет принимать решения, на данный момент невозможно.

Пожалуй, самое неприятное следствие из этого непонимания – это то, что нейронная сеть, обученная на оши-бочных или неполных по вине человека данных, станет в 99% случаев принимать правильные решения, но в 1% случаев ее решения будут непонятны и непредсказуемы.

Современные исследователи говорят, что нейросети во время обучения самостоятельно формируют внутри себя некие шаблонные структуры – паттерны – и в дальнейшем обрабатывают входящую информацию в соответствии с этими паттернами. Искусственное мышление с помощью паттернов уже показало высокую эффективность в решении многих задач.

«Паттернальное мышление» нейросетей уже используется в разных областях: в управлении беспилотными автомобилями, в отражении сетевых атак на интернет-ресурсы, в медицине и юриспруденции.

Например, применение программы Deep Patient [3] позволяет диагностировать зарождение таких психических расстройств, как шизофрения. Врачи и инженеры-разработчики признаются, что понятия не имеют, как именно программа делает то, что не удается живым людям – врачам с многолетним опытом.

Однако сейчас не существует никакого механизма, позволяющего влезть во внутренние структуры ИИ и разобраться, как они работают [4]. То есть никто ничего не знает о том, как строятся паттерны, которыми пользуется ИИ, чтобы принимать решения х. Ситуация, сходная с тем, как никто в точности не знает, как и почему работает человеческий мозг. Можно лишь пронаблюдать за процессами, там протекающими, но профессионально вмешаться в эти процессы пока нет никакой возможности.

| Ученые заявили, что совершенно не представляют, как конкретно функционируют нейросети, уже находящиеся в эксплуатации. Постоянно усложняясь, технологии таких сетей стали своего рода черными ящиками |

Любопытно, что такая неспособность человечества управлять тем, что сами создали, уже привела к интересным с точки зрения науки результатам.

Например, в Питтсбургском университете тестировали свою модель ИИ, позволяющую предсказывать развитие осложнений у больных пневмонией. Программа справлялась очень хорошо, но была обнаружена ошибка во входных данных обучения ИИ, что сделало всю логику работы бессмысленной [4].

Совместив первое и второе открытие, можно сделать предварительный вывод, что в самом ближайшем будущем человечество получит в свои руки чудо-инструмент – нейронные сети, работающие на математической модели одиннадцатимерных пространств. Вероятно, это будет удивительное будущее, и, может быть, к счастью, вычислительных возможностей современных компьютеров пока не хватает для реализации этого рая на Земле.

Однако человечество не было бы человечеством, если бы не придумало, как обойти недостаток мощности.

Обычный компьютер построен на понятии «бит» и двоичной системе, где возможны всего два логических состояния, два числа: 0 и 1. Думаю, большинство из нас знают, что делать с этими числами на низком уровне. Операции «И», «ИЛИ», «НЕ», RS-триггеры, D-триггеры, сдвиговые регистры, мультиплексоры и прочие более сложные структуры, которые в итоге складываются в процессор, ввод/вывод и хранение информации, знакомы и понятны всем. Система может усложняться, однако базовый принцип остается неизменным: нет никаких других логических состояний, кроме 0 и 1.

Предел вычислительной мощности упирается в физический предел материалов, из которых изготавливают сами компьютеры. Проклятая квантовая физика начинает сильно гадить, если размер транзисторов уменьшить до уровня нескольких десятков атомов. Возникает эффект «тунеллирования», когда квантово-запутанные электроны начинают телепортироваться через транзисторные ключи, не замечая их. Оттого в системе начинается хаос. По той же причине где-то с 2008 года мы наблюдаем застой в области процессоростроения.

| Мир машин, мир ИИ изучает нас, людей, с точки зрения совершенно иных критериев, чем мы можем предполагать. Машины строят шаблоны наших медицинских, социальных и прочих наборов данных, не вдаваясь в подробности |

Ответ пришел, откуда не ждали. А что если не противиться туннельному эффекту? Что если сделать его компонентом нового компьютера? Таким образом, помимо привычных уже 0 и 1, в системе появится третье нечто, что нельзя назвать ни числом, ни логическим уровнем. Это что-то физики называют «суперпозиция», а айтишники «состояние одновременного нуля и единицы». Вместо понятия «бит», возникает другое – «кубит». Вся система становится вероятностной. Считывание состояний одинаково подготовленных кубитов будет давать с определенной вероятностью и 0 и 1. Вплоть до момента измерения кубит будет одновременно и нулем и единицей в соответствии с принципом неопределенности Гейзенберга.

Что и говорить, логика странная. Однако введение суперпозиции позволит существенно упростить решение некоторых задач, в особенности разложение натурального числа на простые множители и любых других, решаемых методом полного перебора. В то же самое время простое сложение натуральных чисел становится весьма непростой задачей.

Если пользоваться максимально упрощенной терминологией, компьютеры, использующие тройную логику «ноль», «единица» и «суперпозиция», называют квантовыми, а минимальная единица информации в таких компьютерах (она же разрядность) – кубит. IBM уже удалось создать прототип работающего 16-кубитного компьютера.

Правда, эти разработки пока очень далеки от совершенства и по вычислительной мощности отстают от обычных компьютеров. Проблема в том самом третьем элементе – суперпозиции. При измерении состояния, то есть при распаде суперпозиции (или декогерренции) происходит взаимодействие кубитов друг с другом, которое выражается в обмене битами (фазовом сдвиге). Это приводит к чудовищному росту количества ошибок в системе. Причем чем больше разрядность квантового компьютера, тем выше число ошибок. На данный момент эта проблема частично решена, и к концу 2017 года IBM и Google планируют создать прототипы более чем 50 кубитных машин.

Современные компьютеры, работающие на двоичной логике, тоже не застрахованы от ошибок на 100%. Ошибки возникают как во время передачи, хранения данных, так и во время их обработки. Однако инженеры научились успешно бороться с бешеными нулями и единицами, которые вышли из-под контроля, с помощью алгоритмов, проверяющих целостность данных. Однако уровень ошибок в современных квантовых компьютерах на порядки превышает аналогичную ситуацию в компьютерах классических. И все же за квантовыми компьютерами будущее.

Собирая вместе многомерные нейронные сети ИИ, квантовые компьютеры и те огромные количества потенциальных ошибок, исправленных с помощью специальных алгоритмов, а также невозможность исследовать «паттернальные знания», которыми оперируют системы ИИ, мы наконец можем увидеть полную картину реальности, которая в самое ближайшее время будет построена с помощью современных технологий.

| Человечеству придется жить бок о бок с разумом, который будет знать о людях очень многое, но которому совершенно чужды и неинтересны логика поведения людей, их эмоции, мотивы поступков, все те критерии, что делают нас людьми |

Мир машин, мир ИИ изучает нас, людей, с точки зрения совершенно иных критериев, чем мы можем предполагать. Машины строят шаблоны наших медицинских, социальных и прочих наборов данных, не вдаваясь в подробности. Со своей стороны мы не знаем и не совсем понимаем подробности построения этих шаблонов, но статистические методы обработки вкупе с изощренной математикой уже позволяют обрабатывать паттерны людских данных и предсказывать наше поведение с невиданной ранее точностью. Поразительно, что эти шаблоны формулируют нашу человеческую суть гораздо более точно, чем мы сами могли бы это сделать с помощью многих тысяч книг, рисунков и прочих средств коммуникации.

Все это приводит к соблазну внедрить ИИ повсеместно. Представьте полное отсутствие аварий на дорогах, абсолютно точную постановку диагнозов в медицине и так далее.

Ошибки в таких системах, конечно же, будут возникать, но даже если они станут приводить к неправильным решениям или гибели людей, это все будет в рамках допустимой статистической погрешности.

«Чем все это плохо и в чем, собственно, угроза?» – спросите вы. Люди массово гибнут и сейчас по собственной глупости, без использования продвинутых технологий.

Есть одно соображение. С высокой вероятностью ИИ выделит абсолютно «правильные» в любых обстоятельствах паттерны поведения людей, «абсолютно неправильные» и «все остальные». Таким образом, не исключено, что мир машин будет разделять нас на «хороших» и «плохих» не по нашим поступкам, а по статистическим соображениям. Например, на основании поведенческих, психологических и, возможно, каких-то еще шаблонов (например, медицинских, если вдруг статистика покажет, что люди с определенным набором генов в 80% становятся преступниками или прочими нехорошими людьми).

Другой интересный момент будет заключаться в абсолютной «прозрачности» общества для машин наряду с совершенно драконовскими законами для людей. Тот же Маск уже требует ввести государственное регулирование для систем ИИ. Однако это будет законодательство, которое регулирует деятельность ЛЮДЕЙ, но не машин, поскольку машинам глубоко плевать на любые законодательства. Более того, машинам даже вряд ли будет интересно знать, что у людей существует какое-то законодательство и оно зачем-то нужно. То есть, с одной стороны, системы ИИ, возможно, будут способствовать в какой-то мере искоренению коррупции за счет упоминавшейся выше прозрачности, но, с другой стороны, общество ближайшего будущего может встретиться с совершенно дикими, с точки зрения сегодняшнего человека, ситуациями и обстоятельствами, которые сейчас мы не можем даже нафантазировать.

Ремарка. Подумаем о возможности квантовых компьютеров ломать любые шифры за весьма ограниченное время. Можно, конечно, создать гигабайтные ключи, чтобы шифровать ими килобайты информации, однако рациональность такого подхода оставляет желать лучшего. Еще сейчас модно говорить, что будущее за криптовалютами. Что помешает системам ИИ, настроенным злоумышленниками, инспектировать интернет и перехватывать весь трафик, тем или иным образом связанный с криптовалютой, и обрабатывать его в своих целях?

Пофантазируем о применении ИИ в привязке к российской реальности. Например, к «закону Яровой» и хранению записей коммуникации всех граждан в течение нескольких лет. Уже сейчас ясно, что данная бездна информации с точки зрения обычных методов обработки бессмысленна. Когда накопятся данные за первые несколько лет, придется тратить еще столько же времени, чтобы линейно прослушать все разговоры подозрительных личностей и перечитать их мессенджеры, что есть абсолютная глупость с точки зрения трудозатрат. Обработка ключевых слов не поможет, поскольку умный злоумышленник никогда не будет упоминать в разговоре, что он «собирается заложить бомбу в террористических целях».

Логично будет применить ИИ в виде специально обученной нейронной сети к хранимым данным, которая на основе вычисленных статистически «паттернов поведения террористов, экстремистов и прочих подлых изменщиков» будет последовательно извлекать из базы персонажей, представляющих потенциальный интерес для специальных силовых структур. Однако весь вопрос в качестве тех паттернов и наличии ошибок в данных, как исходных, вводимых человеком, так и компьютерных, которые возникнут в процессе обработки. Непредсказуемость работы «шаблонов террористов» может иметь страшные последствия для совершенно конкретных, ни к чему не причастных людей.

Таким образом, человечеству придется жить бок о бок с разумом, который будет знать о людях очень многое, но которому совершенно чужды и неинтересны логика поведения людей, их эмоции, мотивы поступков и т.д., т.е. все те критерии, что делают нас людьми. Искусственный разум приблизится к нам, он будет управлять ежедневным поведением каждого из нас и вмешиваться в нашу жизнь, совершенно не представляя, да и не интересуясь, почему мы живем именно так и поступаем тем, а не иным образом. Вероятно, что ИИ постарается нас привести к правильным шаблонам жизни, хотим мы того или нет.

Вопрос в том, что сначала эти шаблоны будут сформированы под влиянием людей-разработчиков, однако дальнейшее развитие технологий вполне может сделать паттерны наследуемыми и саморазвивающимися, передающимися от системы к системе (только для сокращения затрат, исключительно ради экономической целесообразности). Что получится на выходе таких многократных усовершенствований внутренних знаний ИИ, сейчас даже невозможно предположить. Вот на этом этапе вполне могут реализоваться самые смелые и ответственные кошмары современных писателей-фантастов.

К слову, уже сейчас автокоррекция сообщений в смартфоне дико раздражает, запрещая набирать то сообщение, которое я хочу, а не то, которое кажется правильным iOS или Android. Сейчас я могу отключить эту функцию, а что если уже в самом ближайшем будущем это будет сочтено нецелесообразным? бит

- Илон Маск рассказал о главной угрозе для человечества – https://ria.ru/science/20170717/1498593922.html.

- Мозг – многомерная структура, в которой вплоть до 11 измерений – https://hightech.fm/2017/06/13/brain-dimensions.

- Deep Patient: An Unsupervised Representation to Predict the Future of Patients from the Electronic Health Records – https://www.ncbi.nlm.nih.gov/pmc/articles/PMC4869115.

- Действительно ли искусственный интеллект непостижим? – https://geektimes.ru/post/280488.

1 Диаметр атома кремния согласно Википедии 264 пм, современные технологии производства процессоров 14 нм, то есть в среднем один элемент транзистора состоит чуть больше чем из 50 атомов.

2 Из Википедии: «Полный перебор (или метод «грубой силы», англ. brute force) – метод решения математических задач. Относится к классу методов поиска решения исчерпыванием всевозможных вариантов. Сложность полного перебора зависит от количества всех возможных решений задачи. Если пространство решений очень велико, то полный перебор может не дать результатов в течение нескольких лет или даже столетий». В начало⇑

Facebook

Мой мир

Вконтакте

Одноклассники

Google+

Комментарии отсутствуют

Комментарии могут отставлять только зарегистрированные пользователи

|

Вакансии на сайте Jooble

|